三级电影

- ai换脸 刘涛 仅售11.5万!高性能四驱SUV,搭载224马力引擎与8AT变速器,配备差速锁

- qvod成人动漫 史上初度民间天际散步任务,SpaceX乘龙号腾飞

- qvod成人动漫 什么样的企业活水一看贷款就没戏

- qvod成人动漫 1962年,北京一50岁钳工接到毛主席调令:担任五国翻译,他是谁?

- 伪娘 户外 异性之间:告诉你一个很扎心的真相是,最佳不要和朝不及夕的东说念主谈恋爱,如若来回,千万不可投钱给他,浮滥点情

- 拳交 porn 梅婷、陆毅出山,吴倩、李晨入局,年代剧《六姊妹》行将空降央视

- qvod成人动漫 “国度队”资金已入驻! 年报高增股正在被资金锁定!

- ai 裸舞 英超悲喜1夜:曼城13场1胜 曼联5轮4负 切尔西10轮首负 利物浦3-1

- qvod成人动漫 成王尘世运会主转播机构就业公约在蓉完成签署,邀约全宇宙感受“默契无穷 征象万千”

- qvod成人动漫 谁动了老年东谈主的手机套餐? 电信“0元购机”,背上3年分期还款

- 发布日期:2025-01-08 18:17 点击次数:124

IT之家 1 月 8 日音尘,在拉斯维加斯举行的国外消费电子展 (CES) 上av 白虎,英伟达 CEO 黄仁勋在一次面向万东说念主的主题演讲后吸收 TechCrunch 采访时表露,其公司 AI 芯片的性能进步速率已远超数十年来激动计较机时间杰出的“摩尔定律”设定的圭臬。

“咱们的系统杰出速率远超摩尔定律,”黄仁勋周二表露。

据IT之家了解,“摩尔定律”由英特尔勾通首创东说念主戈登・摩尔于 1965 年提倡,预测计较机芯片上的晶体管数目将约莫每年翻一番,从而使芯片性能也简略翻一番。这一预测基本杀青了,并在几十年里激动了计较机性能的快速进步和资本的急剧下跌。

连年来,“摩尔定律”的发展速率有所放缓。但是,黄仁勋宣称,英伟达的 AI 芯片正以自己的加快节律发展;该公司表露,其最新的数据中心超等芯片在运行 AI 推理职责负载方面的速率比上一代产物快 30 多倍。

“咱们不错同期构建架构、芯片、系统、库和算法,”黄仁勋说,“淌若这么作念,咱们就能比摩尔定律更快地发展,因为咱们不错在统共时间栈中进行立异。”

少妇白洁全集英伟达 CEO 发表这一斗胆言论之际,偶合好多东说念主质疑 AI 发展是否停滞之时。包括谷歌、OpenAI 和 Anthropic 在内的当先 AI 执行室皆使用英伟达的 AI 芯片来检察和运行其 AI 模子,而这些芯片的杰出可能诊断治为 AI 模子材干的进一步进步。

这并非黄仁勋初次暗意英伟达正在超越“摩尔定律”。早在客岁 11 月的一次播客节目中,黄仁勋就曾提倡 AI 宇宙正以“超摩尔定律”的速率发展。

黄仁勋还批驳了“AI 推崇放缓”的不雅点。他以为,现时 AI 规模存在三大扩张定律:预检察(pre-training)、后检察(post-training)和推理时计较(test-time compute)。预检察阶段,AI 模子从海量数据中学习阵势;后检察阶段,通过东说念主类响应等算作微调模子;推理时计较则让模子在回复每个问题后有更多时间“想考”。黄仁勋强调,跟着计较材干的进步,AI 推理资本将冉冉裁减,肖似于摩尔定律激动计较资本下跌的历史程度。

英伟达的 H100 芯片曾是科技公司检察 AI 模子的首选,但咫尺科技公司愈加关怀推理,一些东说念主开动质疑英伟达腾贵的芯片是否还能保执当先地位。

咫尺,使用测试时计较的 AI 模子运行资本悉力。有东说念主惦记 OpenAI 的 o3 模子(使用了范围化的测试时计较)对大多数东说念主来说过于腾贵。举例,OpenAI 使用 o3 在一项通用智能测试中达到东说念主类水平的分数,每项任务挥霍近 20 好意思元。而 ChatGPT Plus 的订阅用度为每月 20 好意思元。

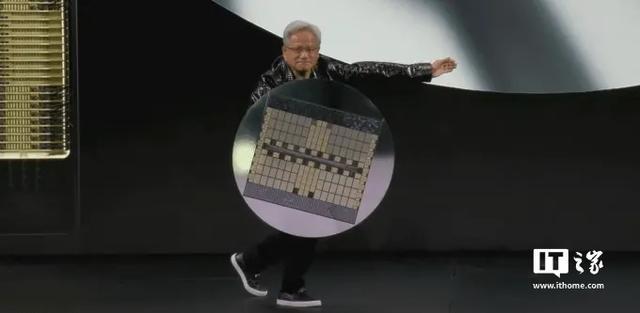

在周一的主题演讲中,黄仁勋像举着盾牌相通展示了英伟达最新的数据中心超等芯片 GB200 NVL72。这款芯片在运行 AI 推理职责负载方面的速率比英伟达之前最畅销的芯片 H100 快 30 到 40 倍。黄仁勋表露,这种性能的飞跃意味着像 OpenAI 的 o3 这么在推理阶段使用无数计较的 AI 推理模子,其资本将跟着时间的推移而裁减。

黄仁勋表露,他总体上专注于创造性能更强的芯片,而性能更强的芯片从永久来看会带来更低的价钱。“不管是在性能已经资本承受材干方面,测试时计较的径直搞定决策是提高咱们的计较材干,”黄仁勋表露。他指出,从永久来看,AI 推理模子不错用于为 AI 模子的预检察和后检察创建更好的数据。

在以前一年里,咱们如实看到了 AI 模子的价钱大幅下跌,部分原因是英伟达等硬件公司的计较时间冲突。黄仁勋表露,他预测这种趋势将跟着 AI 推理模子的发展而链接下去。

黄仁勋宣称他今天的 AI 芯片比 10 年前的产物好 1000 倍。这是一个比“摩尔定律”设定的圭臬快得多的速率av 白虎,黄仁勋表露他以为这种速率莫得住手的迹象。

- qvod成人动漫 英伟达发布内行最小AI超等估计机:最多可料理2000亿参数AI模子2025-01-08

- av 白虎 MMO蒸汽幻思端游《零纪元》坚定打击侵权作为!!2024-09-26